Intent Formalization: AI時代の信頼できる開発

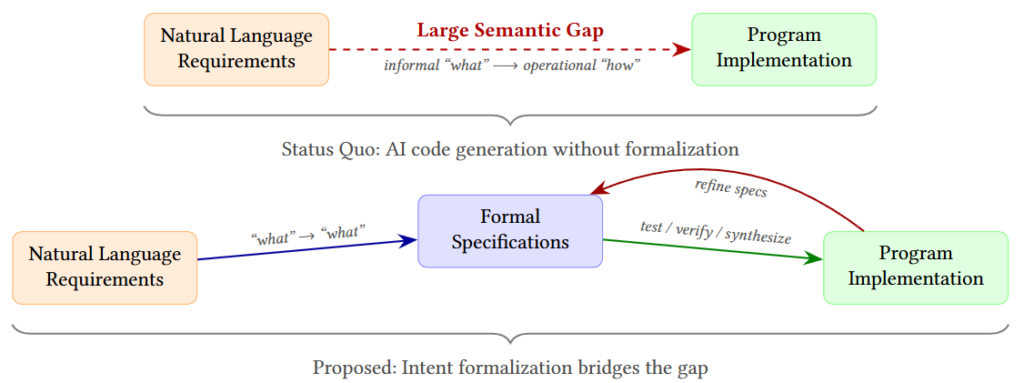

近年、「Vibe coding」に代表される、自然言語で要件を伝えてAIが生成したコードをそのまま受け入れる開発スタイルが普及しつつあります。AIコーディングツールは高速でコードを出力します。ですが、ここで大きな問題となるのが「Intent Gap」です。これは、ユーザーが「意図(Intent)」したことと、実際に「実装(Implementation)」されたプログラムの動作との間に生じる意味的なズレを指します。

AIが生成するコードの量は、すでに人間のレビュー能力を大きく超えつつあります。そのため、「生成されたコードが本当に意図通りに動くのか?」をどうやって確認するかが、開発現場の重大な課題となっています。

この記事では、この課題を解決するためのアプローチである「Intent Formalization(意図の形式化)」について解説します。Microsoft Researchの研究者による最新論文『Intent Formalization: A Grand Challenge for Reliable Coding in the Age of AI Agents』をもとに、AI時代の信頼できるソフトウェア開発にどう取り組むべきかを探っていきます。

1. AIコーディングにおける「Intent Gap」と隠れたリスク

AIが生成するコードは、文法的に正しく、一見もっともらしく見えます。しかしながら、それは決して「構造的に正しさが保証されている」わけではありません。表面的なコードの流暢さの裏には、人間が手書きしたコードよりも見つけにくい、微細なバグが潜んでいるリスクがあります。

この「Intent Gap」が引き起こす問題を、具体的な例で確認します。たとえば、AIに対して「整数のリストから重複を削除して」と指示したとします。 多くのAIは、[1, 2, 3, 2, 4] というリストを受け取ると、単一の要素を残して [1, 2, 3, 4] を返すコードを生成します。しかし、ユーザーの真の意図は「複数回出現した要素をすべて削除して、[1, 3, 4] を返してほしい」ということだったかもしれません。

もし人間のエンジニア同士であれば、業務の背景などのドメイン知識を踏まえたり、「どちらの仕様にしますか?」と対話を通じて曖昧さを解決したりしながら開発を進めるはずです。しかし、大規模言語モデル(LLM)は過去の訓練データに基づいた統計的なパターンマッチングに依存しています。そのため、AIはユーザーの個別の意図を確認することなく、黙って意図と異なるコードを出力してしまうのです。

AI主導の開発に取り組む上では、以下のような隠れたリスクを認識しておく必要があります。

- 一見正しいコードの罠: コンパイルが通り、いくつかのテストを通過したとしても、根本的な意図がずれている可能性がある。

- 意図のサイレントな乖離: 曖昧な自然言語の指示に対し、AIが勝手な解釈で実装を進めてしまう。

- レビューの限界: AIがコードを生成するスピードに人間のレビューが追いつかず、仕様のズレを見逃してしまう。

2. 「Intent Formalization(意図の形式化)」というアプローチ

「Intent Formalization(意図の形式化)」とは、曖昧な自然言語による要件を、機械的にチェック可能な「形式仕様」へと自動翻訳するプロセスを指します。AI主導の開発においては、「AIにコードが書けるか」を問うのではなく、「コードが何をすべきかを明確にし、それを検証する」ための支援をAIに任せることが重要になります。

この形式化には、求める信頼性のレベルに応じて選べる様々な段階(スペクトラム)が存在します。具体的には、以下のアプローチが挙げられます。

- テスト(入出力例): 最も軽量な手法です。AIの解釈が分かれやすい部分をピンポイントで動的に検証する、費用対効果の高いガードレールとして機能します。

- コード契約(事前 / 事後条件・アサーション): プログラムの実行時に動的にチェックされる仕様です。特定の関数の出力に対する制約などを定義し、意図と異なる動作を捉えます。

- 論理的契約とDSL(Domain-Specific Language: ドメイン特化言語): 静的検証ツールを用いた数学的な証明や、完全な仕様からバグのないコードを自動で合成する高度なアプローチです。

特に前半のテストやコード契約については、言語を問わず既存の開発環境へすぐに導入できるため、実務の第一歩として取り組みやすいという利点があります。

3. 意図のすり合わせを自動化・効率化する実務的な手法

ここまで、意図を「形式化」するアプローチについて解説しました。しかし、ここで最大の壁にぶつかります。それは、「AIが生成した仕様そのものが、本当にユーザーの意図と合致しているのか?」を検証する方法です。なぜなら、仕様の正解(オラクル)はユーザーの頭の中にしか存在しないからです。

この課題を解決するために、具体的なテストケース(入出力例)を活用して、仕様の品質を自動で測定するアプローチが研究されています。具体的には、以下の2つの指標を測定します。

- 健全性 (Soundness): その仕様が、正しい動作をちゃんと許可するかどうか。

- 完全性 (Completeness): その仕様が、誤った動作を確実に弾くことができるかどうか。

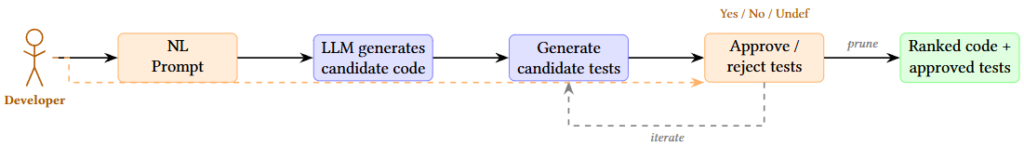

しかし、毎回のテストケース作成をすべて手作業で進めるのは現実的ではありません。そこで、開発現場ですぐに活かせる方法として、「TiCoder」と呼ばれるテスト駆動型のインタラクティブな手法が注目されています。

TiCoderは、AIにコードだけでなく「解釈が分かれそうな境界値のテストケース」も同時に出力させる仕組みです。開発者は、AIから提示されたテストの実行結果(入出力のペア)を見て、「Yes(意図通り)」「No(意図と違う)」を判断するだけで済みます。

たとえば、「2つのリストの共通要素を見つけて」と指示したとします。AIが「[1, 2, 2] と [2, 3, 2] の共通要素は [2, 2] ですか?」というテストケースを提示したとしましょう。もしあなたが「重複は省いてだけ [2] を返してほしい」と考えていたなら、「No」を選択します。

このように、テストケースを通じたシンプルな対話を繰り返すことで、無数にあるコード候補の中から意図に合わないものを自動的に絞り込むことができます。高度な専門知識がなくても、AIにテストケースを提示させ、それに答えるというワークフローを取り入れるだけで、AIとの意図のズレは大きく解消できるのです。

4. 今後の展望とワークフローの進化

今後、開発者の役割は自らコードを書く「執筆者」から、AIの生成物を管理する「監督者」へとシフトしていきます。開発者が直接コードを読まなくなる時代だからこそ、機械的に検証可能な「仕様」が、人間とAIをつなぐ主要なインターフェースとなります。

現在の研究は、独立した単一のアルゴリズム機能に焦点を当てたものがほとんどです。しかしながら、実際のシステム開発はより複雑です。データベースの状態変更や非同期処理が絡むシステムに対して、どのように意図を形式化するかが今後の焦点となります。

また、実務の多くはゼロからの新規開発ではなく、既存コードへの「変更」です。「バグの修正」や「キャッシュ機能の追加」といった変更の意図を、既存のソースコードやテストとどのように組み合わせていくかも、解決すべき重要な課題です。

こうした課題を乗り越え、AI主導の開発ワークフローへ意図の形式化が統合されると、現場では以下のような様々な変化が期待できます。

- Issue 作成: コードを書き始める前に、期待する振る舞いをテストやアサーションとして定義し、AIへの指示として活用する。

- コードレビュー: 人間はAIが書いた複雑な実装そのものではなく、「意図が正しく仕様化されているか」をレビューの主眼に置く。

- CI/CD(継続的インテグレーション / デリバリー): 要件の変化に合わせて、AIエージェントが自律的に仕様を発見し、継続的に検証を進める。

意図の形式化は、単なるテスト手法にとどまらず、AI時代の信頼できる開発プロセスを支える基盤として組み込まれていくはずです。

おわりに

AIによるコード生成時代において、ソフトウェアの信頼性を決定づけるのは、いかにユーザーの「意図」とAIによる「実装」のギャップを埋めるかという点にあります。

Intent Formalization(意図の形式化)は、決して難解なアプローチではありません。テストやアサーションといった軽量なレベルからすぐに現場へ導入でき、意図のズレを防ぐ費用対効果の高いガードレールとして機能します。

生成されたコードを盲目的に受け入れるのではなく、「システムがどう振る舞うべきか」という仕様をAIと共に明確にし、検証するプロセスを開発に取り入れることが重要です。この記事が、AIと協調するこれからの信頼できる開発スタイルを構築するヒントになれば幸いです。

More Information

- arXiv:2603.17150, Shuvendu K. Lahiri(Microsoft Research), 「Intent Formalization: A Grand Challenge for Reliable Coding in the Age of AI Agents」, https://arxiv.org/abs/2603.17150