LLMの学習と推論のメカニズム: なぜプロンプトで性能が変わるのか?

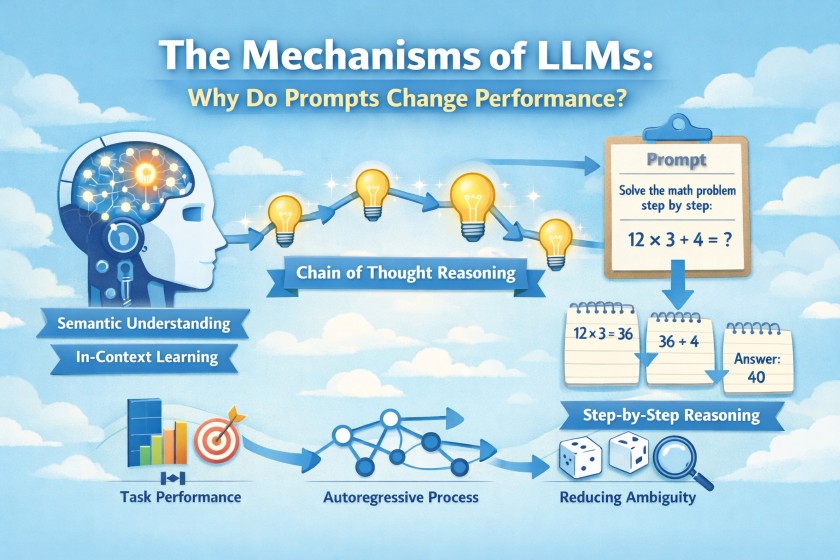

大規模言語モデル(LLM)は、「Next Sentence Prediction (NSP)」という極めてシンプルな目的で学習されているにもかかわらず、驚くほど高度な文脈理解や推論能力を発揮します。さらに興味深いことに、モデルのパラメータを一切更新せずとも、In-Context Learning (ICL) や Chain-of-Thought (CoT) といったプロンプトの工夫を取り入れるだけで、その性能は劇的に変化します。なぜ、プロンプトの設計だけでこれほどの違いが生まれるのでしょうか?

本記事では、この疑問に答える最新論文「Beyond the Prompt in Large Language Models: Comprehension, In-Context Learning, and Chain-of-Thought」をベースに、プロンプト手法がモデルの性能を向上させる理論的なメカニズムを紐解きます。

記事のゴールとして、ゼロショット、ICL、CoTという3つのプロンプト戦略の仕組みと統計的な優位性を統一的な枠組みで比較します。これらが機能する根本的な理由を理解することで、実務におけるより効果的なプロンプト設計のヒントを探っていきます。

1. 基盤理論: 言語生成モデルとTransformerの表現力

LLMがプロンプトによって高度な能力を発揮する理由を探るためには、まず「モデルが言語生成をどのように捉えているか」を理解する必要があります。そこで、LLMの事前学習プロセスを数学的に評価するために、以下の3つの観点から理論的基盤を概観しています。

- 言語生成プロセスの定式化: 自然言語の生成プロセスを「潜在タスクのサンプリング」と「ドキュメントの生成」という2段階の階層的潜在変数モデルとして定義します。例えば、「アインシュタインは」というプロンプトの続きを生成する際、その背後には「職業を答える」といった観測できない意図(潜在タスク \(\theta\) )が存在すると仮定します。このアプローチにより、自然言語における複雑な文脈の依存関係を、背後にある意図に従って単語(トークン)を順次サンプリングしていくプロセスとして数学的にモデル化できます。

- 理論的表現力と浅いネットワークの仮定: Transformerが人間の言語分布をどの程度正確に学習できるかを示すため、深さ \(D=1\)(単層)、幅 \(W=O(|V|n+1)\) (\(|V|\)は語彙サイズ、\(n\)は最大系列長)という極めて浅いネットワークを仮定して誤差バウンドを導出します。一見すると単純すぎるように思えますが、単層であっても十分な幅を持たせることで、複雑な確率分布に対する膨大な記憶容量(Memorization)を確保できることが証明されています。この仮定は、実際の多層モデルが持つ汎化能力や言語表現力を理論的に裏付けるための強固な土台として機能しています。

- アーキテクチャの忠実度(Architectural Fidelity): 既存の理論研究の多くは、数学的な証明を容易にするために、アテンション機構のSoftmax関数をReLU関数などに置き換えて解析を実施していました。そこで、アーキテクチャの忠実度を担保するために、標準のSoftmax関数を維持したまま証明を進めていきます。具体的には、Softmax関数に基づく「Boltzmann演算子の分離性」という性質を活用します。これにより、標準的なアテンション機構が様々な入力シーケンスから大局的な情報を集約し、各トークンに対して適切に意味を割り当てる「文脈マッピング(Contextual Mapping)」をいかに実現しているかを厳密に明らかにできます。

2. In-Context Learning (ICL) による「タスクの曖昧さ」の解消

ゼロショット生成では、入力されたプロンプトからユーザーの意図を一つに絞りきれないことがよくあります。この不確実性を、事後確率を用いた「タスクの曖昧さ(Task Ambiguity)」として定義してみましょう。

例えば「アインシュタインは…」というプロンプトに対して、「物理学者(職業)」なのか「ドイツ生まれ(出身)」なのか、これだけの情報ではモデルも判断に迷ってしまいます。ここで効果を発揮するのが In-Context Learning (ICL) です。ICLは、文脈にいくつかの例(デモンストレーション)を追加することで、このタスクの曖昧さを劇的に減らしてくれます。

このICLが機能するプロセスを理論的に読み解く上で、特に重要なポイントは以下の3点です。

- 事前分布の不均衡(Prior Imbalance)の考慮: 既存の理論研究の中には、デモンストレーションを追加すれば「必ず」ゼロショットの曖昧さが減ると結論づけているものがありました。しかし、これは実際のモデルの挙動と矛盾することがありました。この矛盾を解消するためには、タスク空間における「事前分布の不均衡」を評価に組み込む必要があります。モデルが元々持っているタスクの偏り(バイアス)を考慮することで、ICLがうまく機能するためのより堅牢な条件を提示できるのです。

- 指数関数的減衰と事後確率の集中: 事前分布の不均衡を適切に乗り越えられる例を用意できれば、提示するデモンストレーションの数を増やすにつれて、タスクの曖昧さは指数関数的に減少していきます。例を追加すればするほど、不要な候補が排除され、目的のタスクへ事後確率が一点に集中していくメカニズムが数学的にも裏付けられています。

- 構成的ボトルネック(Compositional Bottleneck)という限界: 一方で、ICLも決して万能ではありません。算数の文章題のような複雑な多段階推論に直面すると、標準的なICLは途端に失敗しやすくなります。これは「構成的ボトルネック」と呼ばれています。未知の複雑な推論経路(非定常な軌跡)を正確に橋渡しするための、構造的な細かさ(粒度)がICLのプロンプトには欠けていることが原因です。

このように、ICLは単純なタスクの意図を明確にするには非常に強力ですが、複数の手順を組み合わせるような高度な問題解決には、構造的な限界が存在することがわかります。

3. Chain-of-Thought (CoT) による構成的シフトの克服

複雑な多段階推論において、標準的なICLが直面する限界(構成的ボトルネック)を鮮やかに打ち破るのがChain-of-Thought (CoT) です。途中の推論プロセスをプロンプトに含めることで、なぜモデルは突如として高度な推論が可能になるのでしょうか。その理論的な背景には、以下の3つの重要なメカニズムが存在します。

- 構成的シフト(Compositional Shift)という新たな課題: LLMは事前学習において、単一の意図に従って文章を生成する「定常的な」分布を学習しています。しかし、複雑な推論タスクでは、複数の異なる手順を組み合わせた「非定常な」軌跡を辿る必要があります。この事前学習時と推論時における分布のズレは「構成的シフト」と呼ばれ、LLMにおける新しい転移学習の枠組みとして捉えることができます。

- 「原子タスク」の組み合わせによるシフトの解決: CoTは、複雑な推論プロセスをプロンプト上で明示することで、モデルに本来備わっている「タスク分解能力」を活性化させます。たとえば、算数の文章題を「掛け算」「足し算」「結果の抽出」といった、事前学習ですでに完璧に習得済みのシンプルな「原子タスク(Atomic Tasks)」へと分解するのです。未知の複雑な推論経路であっても、既知の原子タスクの連なりとして捉え直すことで、構成的シフトを克服し正しい答えに辿り着くことができます。

- K-separation仮定と「論理のロックイン」: 理論的な分析によると、ICLの誤差がデモンストレーション数 \(m\) に対して指数関数的に減少するのに対し、CoTの誤差は \(m^K\) というさらに強力なオーダーで減少することが示されています。ここで鍵となるのが「K-separation」という仮定です。これは、異なる推論経路間のズレ(ハミング距離)が \(K\) ステップ以上離れている状態を指します。 これを現実のプロンプト設計に当てはめると、「間違った論理プロセスと正しいプロセスが、どれだけ明確に区別しやすいか」に対応しています。推論のステップが論理的かつ明確(\(K\) が大きい)であればあるほど、モデルは途中で誤った推論に迷い込むことなく、正しい推論経路へと確実に「ロックイン(固定)」される役割を果たします。

このように、CoTは単なる「回答のヒント」ではなく、複雑なタスクをモデルが処理できる粒度に分解し、正しい道筋へ導くための極めて合理的なメカニズムとして機能しています。

4. モデルの限界と今後の研究に向けた拡張

これまで、ゼロショット、ICL、CoTという3つのプロンプト戦略が機能するメカニズムを解説してきましたが、LLMの推論能力を数学的に完全に説明するには、まだ多くの課題が残されています。ここでは、現実の開発現場に即したモデルの限界と、今後の展望について考察します。

- エビデンス・シフト(Evidence Shift)への対応: LLMを活用したシステム開発では、プロンプトで要求する出力フォーマットや論理構造が、モデルが事前学習で経験したデータセットと大きく異なるケースが頻繁に発生します。このような、事前学習時と推論時における言語スタイルや論理構造の不一致は、「エビデンス・シフト(Evidence Shift)」として定義されています。 最新の理論的な枠組みでは、このシフトによるズレを数学的な誤差評価に組み込むことで、より現実に即したモデルの挙動を説明する試みが進められています。このアプローチをさらに発展させることで、デモンストレーションを提示せずに推論を促す「Zero-shot CoT」のように、事前学習データに存在しない未知の推論パスをモデルが自律的に構築する能力についても、理論的な裏付けが得られると期待されています。

- 高度なプロンプト戦略への応用展望: 今回紹介したゼロショット、ICL、CoTの統計的な優位性を統一的に比較するアプローチは、より複雑なプロンプト戦略のメカニズムを解明するための強固な基礎となります。 今後の展望として、この評価手法を Tree of Thoughts (ToT) や Graph of Thoughts (GoT) のような、多角的な探索を伴う高度な手法の理論的解析に応用していくことが考えられます。

ただし、こうした高度な手法を数学的に厳密に解析するためには、これまでの前提に加えて、新たな仮定を定式化する必要があります。

- 木構造上の探索プロセス: 複数の推論パスを並行して生成し、それぞれを評価・検証する過程の数学的な表現。

- 分岐における不確実性の制御: 推論の各ステップで論理が枝分かれする際に、正しい経路をいかにして選択(ロックイン)するかを担保する確率的な条件。

このように、LLMの推論メカニズムの解明は、単なる統計的な確率計算にとどまらず、モデルからいかにして確かな「論理構造」を引き出すかという、新たな段階へと踏み出しています。

おわりに

本記事では、LLMがパラメータを更新せずとも、プロンプトの設計次第で推論性能を劇的に向上させる数学的なメカニズムを解説しました。具体的には、ICLが文脈を通じて事後確率を目的のタスクへ集中させる仕組みや、CoTが複雑で非定常な軌跡を学習済みの原子タスクへと分解するプロセスを紐解きました。

こうした理論的な背景は、日々のシステム開発におけるプロンプト設計に様々な示唆を与えてくれます。実務で特に意識すべきポイントは以下の2点です。

- 曖昧さの徹底的な排除: デモンストレーションを通じて、モデルがタスクの意図を一つに絞り込めるように明確なコンテキストを提示する。

- 明確な論理ステップの設計: 「K-separation」を意識し、誤った推論経路と明確に区別できるレベルまでタスクを細かく論理的に分解する。

LLMの複雑な挙動も、理論のレンズを通すことで、より確実で効果的な制御へと繋げていくことができます。

More Information

- arXiv:2603.10000, Yuling Jiao et al., 「Beyond the Prompt in Large Language Models: Comprehension, In-Context Learning, and Chain-of-Thought」, https://arxiv.org/abs/2603.10000