反証可能性の壁:LLMは科学的研究を促進させるのか?

近年、GPT-5などの最先端モデルが、数学や物理、生物学といった様々な分野で新たな知見を生み出し、人間レベルの知能を示しているという報告が相次いでいます。モデルが複雑な課題を解き、科学の研究プロセスを大幅に加速させる様子 […]

Prompt Repetition: プロンプト反復によるLLMの改善

LLMの精度向上のために、日々プロンプトの試行錯誤を繰り返しているエンジニアは多いはずです。Google Researchの研究チームは、そのような課題に対し、非常にシンプルかつ強力な解決策である「Prompt Repe […]

LLM-as-classifier: 階層的テキスト分類器の構築方法

2010年代以降、膨大なテキストデータから深い意味的パターンを認識するニーズは、かつてないほど高まっています。これまでのテキスト分類は、大量のラベル付きデータを用いたファインチューニング(Fine-tuning)が主流で […]

2025年まとめ: AI関連の必読論文 総チェック

2025年は、AI技術が「生成」から「推論(Reasoning)」、そして「自律的なエージェント(Agentic AI)」へと劇的な進化を遂げた1年でした。LLMの効率化から、マルチモーダル化、さらにはAI自身が科学的発 […]

Deep Research 完全ガイド: 自律型LLMエージェントとアーキテクチャ

近年、大規模言語モデル(LLM)は、単にテキストを生成するだけでなく、複雑な問題解決を可能にする強力なエージェントへと急速に進化しています。しかし、現実世界の多くのオープンエンドなタスクは、単一のプロンプトや標準的なRA […]

promptolution: Pythonによるプロンプト最適化の実践

大規模言語モデル(LLM)を活用する際、その出力性能は入力プロンプト(指示文)の品質に大きく左右されます。この「プロンプトの感度(sensitivity)」は非常に高く、意味的に類似しているように見えるわずかな表現の違い […]

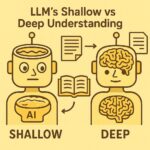

LLMの浅い理解と深い理解: AIは本当に言葉を理解しているのか?

生成AIは驚くほど流暢な文章を作成します。しかし一方で、事実とは異なる内容をもっともらしく語る「ハルシネーション」や、論理的に破綻した回答を生成することも少なくありません。なぜAIは、「言葉」の操り方は完璧なのに「意味」 […]

QueryGym: LLMベースの Query Reformulation フレームワーク

検索システムの改善において、ユーザーの曖昧な入力意図を補完する「クエリ拡張(Query Reformulation)」は、LLMの登場により劇的な進化を遂げています。しかし、論文で提案される有望な手法も、実装コードが散逸 […]

大規模言語モデルは知性か?現代AIの能力と限界

近年、大規模言語モデル(LLM)が示す驚異的なテキスト生成能力は、我々に「これは真の知性なのか?」という根源的な問いを投げかけています。その流暢さの裏で、LLMが膨大なテキストの統計的パターンを模倣しているだけの「確率的 […]

Socratic Self-Refine: 問答的自己改善によるLLMの推論能力向上

大規模言語モデル(LLM)は、Chain-of-Thought(CoT)プロンプティングを用いることで、数学的な問題解決から複雑な論理推論に至るまで、目覚ましい推論能力を発揮しています。しかし、推論過程を明示するCoTは […]