Fisher Matrix 入門: 実験精度を予測するための手法

データ分析のプロジェクトや新しい実験を計画する際、事前に「どの程度のデータを集めれば目標の精度に到達できるか」を見積もることは、コストと成果のバランスを最適化する上で欠かせないステップです。

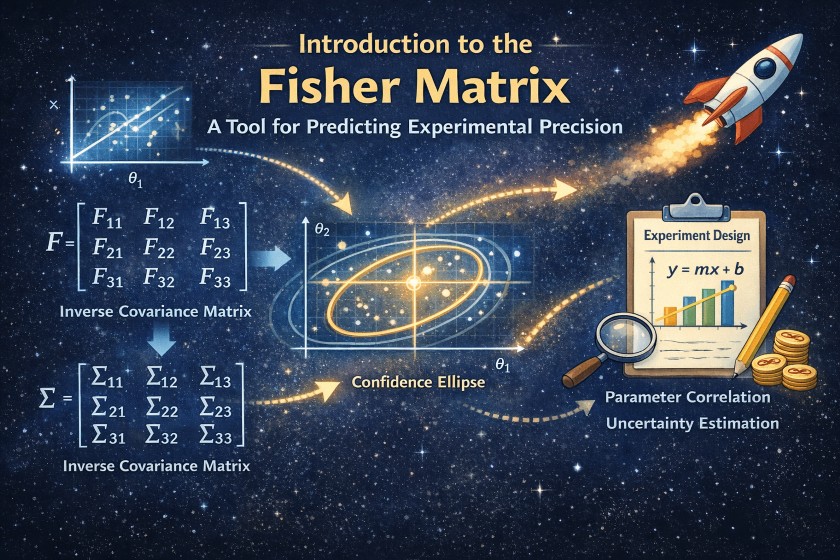

このような実験設計において強力な武器となるのが、Fisher Matrix(フィッシャー情報行列) です。これを利用すれば、詳細なシミュレーションを実施せずとも、パラメータの推定精度を予測することができます。理論上、この行列の逆行列を計算することで、推定量が到達しうる分散の下限値である「Cramér-Rao bound(クラメール・ラオの下限)」を導出可能です。

一方で、具体的な解析手順を構築せずに予測できる手軽さは「諸刃の剣」でもあります。実際の解析でこの理論値に到達できる保証はないため、計画が定まった後はモックデータを用いて手法を検証することが重要です。

本記事では、この Fisher Matrix を使った予測手法について、基礎的な考え方から実践時の注意点までを順を追って解説します。

1. 定式化と計算: 基本から一般化まで

Fisher Matrix の具体的な計算方法を見ていきましょう。最もよく使われるのは、各観測データの測定誤差がガウス分布に従うと仮定できるケースです。この場合、Fisher Matrix の各要素 \(F_{ij}\) は以下の数式で計算されます。

$$F_{ij} = \sum_b \frac{1}{\sigma_b^2} \frac{\partial f_b}{\partial p_i} \frac{\partial f_b}{\partial p_j}$$

ここで、\(f_b\) は観測モデル、\(p_i\) や \(p_j\) は推定したいモデルパラメータ、\(\sigma_b\) は測定誤差を表します。この式に登場する偏微分は、パラメータの微小な変化に対して、観測モデルがどれほど敏感に応答するかを示しています。つまり、パラメータの変化がデータに大きく影響する(微分値が大きい)ほど、そのパラメータに関する「情報量」が多く得られると解釈できます。

一方で、実際のデータ分析では、誤差が必ずしもガウス分布に従わない様々な状況に直面します。より一般的なケースでは、対数尤度(Log-Likelihood) \(L\) を用いて次のように定義されます。

$$F_{ij} = \frac{\partial \ln L}{\partial p_i} \frac{\partial \ln L}{\partial p_j}$$

先ほどのガウス誤差の公式は、尤度関数にガウス分布を当てはめた結果として導出されるものです。

また、計算を進める上で知っておくべき重要な性質があります。それは、データへの直線あてはめのように、観測モデルがパラメータに対して線形である場合、微分の項がモデルパラメータの値に一切依存しないという点です。

これは非常に特筆すべき性質です。非線形モデルで実験の精度を予測する場合、通常は「パラメータがだいたいこの値だろう」という事前の仮定が必要になります。しかし線形モデルの場合はその必要がなく、実際のパラメータがどんな値になるかにかかわらず、予測を完結させることができます。

2. 具体例からの洞察: 観測の最適化と共分散の制御

理論的な定式化から少し視点を変えて、具体的な直線のあてはめ(\(f = ax + b\))を例に、Fisher Matrix が実験設計においてどのような洞察をもたらすかを見ていきましょう。コストの制約などにより、データ点を2つ(\(x_1\) と \(x_2\))しか観測できないケースを仮定します。

- 観測点の最適化 – 距離を離すメリット: 直線の「傾き(\(a\))」を可能な限り高い精度で推定したい場合、2つの観測点はどこに配置すべきでしょうか。直感的にも「できるだけ離す」のが良さそうに思えますが、Fisher Matrix を用いればこれを定量的に証明できます。 実際に Fisher Matrix を構築して逆行列(共分散行列)を求めると、傾きの分散は \(\frac{\sigma_1^2 + \sigma_2^2}{(x_1 – x_2)^2}\) と計算されます(\(\sigma_1, \sigma_2\) は各観測点での測定誤差です)。この数式の分母には \((x_1 – x_2)^2\) があるため、2点の距離を離せば離すほど、傾きの推定誤差を確実に小さくできることがわかります。

- 共分散の消去 – パラメータ間の相関をなくす: さらに Fisher Matrix は、直感だけでは気づきにくい強力な設計方針も提示してくれます。 一般的に、直線をあてはめる際、傾きと切片(\(b\))の推定値の間には相関(共分散)が生じます。これは、傾きの推定がわずかにずれた場合に、その帳尻を合わせるように切片の推定値も引っ張られてしまう状態を指します。 しかし、計算された共分散行列の非対角成分(共分散を表す部分)に注目すると、観測点 \(x_1\) と \(x_2\) を以下の条件を満たすように配置すれば、この共分散を完全にゼロ(無相関)にできることがわかります。

$$\frac{x_1}{x_2} = -\frac{\sigma_1^2}{\sigma_2^2}$$

このように観測点を意図的に選ぶだけで、傾きと切片の推定が互いに干渉しなくなります。もし実験において「各パラメータを独立して正確に評価すること」が重要な要件であるならば、このように事前の計算から最適な観測条件を逆算できる点は、大きな強みとなります。

3. 信頼区間の可視化: 予測楕円の正しい描き方と解釈

計算して得られた共分散行列の数値を表として眺めるだけでは、直感的な理解は難しいかもしれません。複数の実験計画を比較・評価する際には、パラメータ空間上に Confidence Ellipse (信頼楕円) として可視化することが非常に有効です。ここでは、予測楕円を正しく描き、解釈するためのポイントを整理します。

- 固有値と固有ベクトルの幾何学的な意味: 共分散行列は対称行列であるため、その固有値と固有ベクトルには明確な幾何学的意味があります。具体的には、共分散行列の固有値が楕円の主軸(長軸および短軸)の長さを決定し、固有ベクトルが楕円の傾き(回転角)に対応します。この性質を利用すれば、パラメータ間の相関の強さや不確実性が及ぶ方向を直感的に把握できます。

- 次元性とスケーリングの罠: 楕円を描画する際、多くの人が陥りやすい落とし穴があります。それは、1つのパラメータに関する1次元の68%信頼区間の幅を、そのまま2次元の Joint Confidence Interval (同時信頼区間) に適用してしまうことです。 2次元空間において、1次元と同じ幅(たとえば半径1の円)を描いた場合、その領域に含まれる確率分布の割合は68%を大きく下回ります。そのため、2次元ガウス積分の計算に基づいて、楕円を意図的に拡大する必要があります。具体的には、共分散行列の固有値の平方根に対して、約1.52(正確には1.5158)倍のスケーリングを実施することで、正しい68%同時信頼区間の楕円を描画できます。

- プロットの解釈と理論的限界: 他の文献やプレゼンテーションで、予測プロットが「完璧な楕円」を描いているのを見かけたことはありませんか。もしそうであれば、それは実際のデータを解析した結果ではなく、Fisher Matrix によって計算された予測値である可能性が高いと言えます。 実際の実験には様々なノイズや nitty-gritty details (泥臭い詳細) が含まれるため、モックデータを生成して詳細なシミュレーションと解析を進めた結果が、完璧な楕円になることは稀です。完璧な楕円は、「実験が理想的に進んだ場合に到達できる理論的な最高精度」を示しているに過ぎない点に留意してください。

4. 非線形モデルへの対応: 基準モデルと微小摂動の罠

前段落で触れた線形モデルでは、パラメータの値に依存せずに精度予測が完結する特質がありました。しかしながら、指数関数のような非線形モデルを扱う場合、偏微分の結果がパラメータ自身の値に依存するため、少し工夫が必要になります。ここでは、非線形モデルを扱う際の重要な考え方と注意点を整理します。

- 基準値の必要性と循環論法の否定: 非線形モデルで予測を進めるには、計算の出発点として「パラメータはこの程度の値だろう」という仮定をあらかじめ設定しなければなりません。この仮定のために用意するモデルを Fiducial Model(基準モデル) と呼びます。 「結果を知るために実験を計画しているのに、事前に値を仮定するのは循環論法ではないか」と疑問に思う方もいるでしょう。ですが、心配は無用です。この仮定はあくまで「実験の精度」を予測するためのものであり、「実験の結果」そのものを予測しているわけではないため、論理的な破綻はありません。

- 微小摂動の罠と過小評価: Fisher Matrix は、パラメータの「無限小の摂動(ごく微小な変化)」に対してデータがどう応答するかを基に計算される、という前提を持っています。この性質により、特定の条件下では予測に限界が生じます。 わかりやすい例として、放物線のモデル(\(y = a(x – b)^2\))を考えてみましょう。このモデルの頂点(\(x \approx b\))付近でデータを観測する場合、微小な変位に対するパラメータ \(b\) の微分値はゼロになってしまいます。実際の実験において有限の変位が生じれば、当然データから何らかの情報を得ることができます。しかし、無限小の摂動しか考慮しない枠組みの中では「頂点付近のデータからは情報が全く得られない」と見なされてしまいます。 その結果、本来得られるはずの精度が計算に反映されず、予測が過度に悲観的(過小評価)になってしまうケースがある点には注意が必要です。

5. 事前情報と周辺化: ヌイサンスパラメータの適切な処理

実際のデータ分析では、過去の実験結果や理論的な制約など、すでに判明している知識を活用したい場面が多々あります。また、分析の主目的ではないものの、現実の誤差要因として考慮しなければならない Nuisance Parameters(ヌイサンスパラメータ:局外母数) をどう処理するかも重要な課題です。Fisher Matrixの枠組みを利用すれば、これらを非常にシンプルに扱うことができます。

- 事前情報の組み込み: 過去の知見などの Prior(事前情報) を統合する作業は、極めてシンプルに実行できます。その事前情報が持つ不確実性の逆分散(\(1/\sigma^2_{\text{prior}}\))を計算し、Fisher Matrixの該当する対角成分に加算するだけで処理が完了します。これにより、今回の実験単体では十分な精度が出ないパラメータであっても、過去の知識と組み合わせることで予測を進められるようになります。

- 事前分布の制約: 便利な一方で、この計算手法に組み込める事前分布は必然的にガウス分布(正規分布)に限定される点には注意が必要です。特定の範囲内のみで均等な確率を持つ「一様分布(Tophat型)」のような事前情報を直接扱うことはできないため、必要に応じてガウス分布で近似して計算を進める必要があります。

- 周辺化(Marginalization)の容易さ: 分析に関心のないヌイサンスパラメータの影響を排除し、特定のパラメータの不確実性だけを評価する Marginalization(周辺化) の処理も手間がかかりません。実際のデータ解析では複雑な積分計算を実施する必要がありますが、予測の段階ではFisher Matrixの逆行列を計算し、目的のパラメータに対応する分散・共分散の値をそのまま読み取るだけで周辺化が完了します。

- 理想的な状態 – 自己キャリブレーション: 装置の測定誤差(キャリブレーション係数など)をヌイサンスパラメータとしてモデルに組み込んだ場合、外部からの事前情報を一切与えなくても、データ自身がそのパラメータを強く制約することがあります。これは Self-calibration(自己キャリブレーション) と呼ばれる状態です。モデルの設計と実験デザインがうまく噛み合うことで、余分な不確実性を増やさずに、科学的な目的と誤差補正の両方を同時に達成できる理想的な状態と言えます。

6. 実装時の注意点: 複数実験の結合と数値的不安定性

最後に、Fisher Matrixをプログラムとして実装し、実際のプロジェクトへ適用する際に直面しやすい課題と、その対処法について解説します。

- 複数実験の結合とショートカットの罠: 複数の独立した実験結果を組み合わせて精度予測を進める場合、基本的にはそれぞれのFisher Matrixを足し合わせるだけで情報の統合が完了します。 しかし、計算時の「ショートカットの罠」には注意が必要です。計算負荷を下げるため、行列が巨大になりすぎるのを防ごうと、「各行列を足し合わせる前に、それぞれで Nuisance Parameters(ヌイサンスパラメータ) を周辺化してサイズを縮小しておく」という手法がよく検討されます。 このショートカットが許容されるのは、各実験間でヌイサンスパラメータが無相関である場合に限られます。実験をまたいで相関を持つパラメータが存在するにもかかわらず、この手順を適用してしまうと誤った結果を導くため、慎重に設計を検討する必要があります。

- 数値的不安定性への対処: 特定のパラメータを「完全に既知の値」として固定してシミュレーションを進めたい場面があるかもしれません。このとき、極端に大きな事前情報(Prior)の値をFisher Matrixの該当する対角成分に加算して表現しようとすると、計算上の問題が生じます。 巨大な数値を無理に代入することで、行列の条件数(最大固有値と最小固有値の比)が極端に増大し、逆行列を求める際に数値的な不安定性を招く恐れがあるからです。 このような事態を回避するには、対象となるパラメータに対応する「行と列そのものをFisher Matrixから完全に取り除く」というアプローチをとる方が安全です。これにより、行列の安定性を保ちつつ、パラメータを固定した状態での予測を正確に実施できます。

おわりに

Fisher Matrix(フィッシャー情報行列)は、詳細なシミュレーションを実施せずとも、最小限の計算リソースで実験や観測のポテンシャルを定量化できる優れたツールです。データ収集のコストと得られる精度のトレードオフを事前に評価できるため、プロジェクトの初期段階で強力な武器となります。

一方で、本記事で解説したように、その運用にはいくつかの注意点も存在します。線形モデルと非線形モデルにおける基準モデルの必要性の違いや、事前情報として組み込める分布の制約、そして逆行列を計算する際に生じる数値的不安定性など、理論的な枠組みと計算上の落とし穴を正しく理解しておくことが不可欠です。

これらの特性や限界を踏まえた上で、ぜひ Fisher Matrix をご自身のデータ分析プロジェクトや効率的な実験設計に活用してみてください。

More Information

- arXiv:2510.09683, David Wittman (UC Davis), 「Fisher Matrix for Beginners」, https://arxiv.org/abs/2510.09683